Prof. Dr. med. Franz A. Fellner

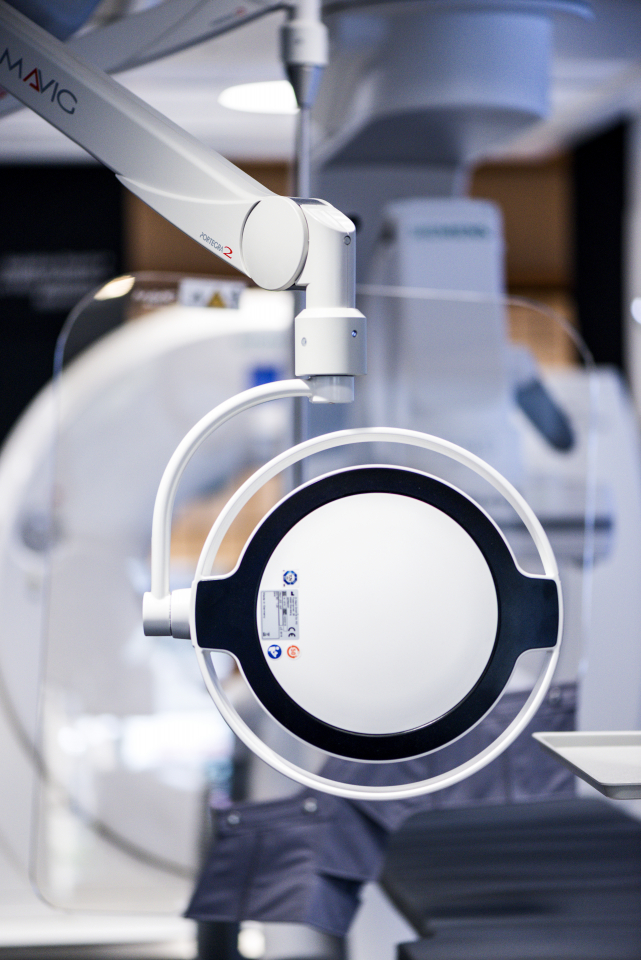

Aus medizinischer Sicht ist die Computertomografie dort wichtig, wo es um die Untersuchung eines kranken Menschen innerhalb einer sehr kurzen Zeit geht, zum Beispiel um die Untersuchung des Brustkorbs, des Bauchraums, oder bei akuten Fällen, etwa bei einer Gehirnblutung oder bei einem frisch verletzten Patienten. Die Computertomografie schafft die Untersuchung des kompletten menschlichen Körpers heute innerhalb von etwa zehn Sekunden, manchmal sogar in eineinhalb Sekunden. Bei der Magnetresonanztomografie hingegen sind die Messzeiten sehr lang, der Patient liegt in der Regel 15 bis 45 Minuten lang in der Röhre. Die MRT bildet die Weichteile noch besser als die CT ab und kommt deshalb zum Beispiel bei Untersuchungen des Gehirns und Rückenmarks, Bandscheibenvorfällen, Bandverletzungen im Bewegungsapparat oder auch in der Diagnostik innerer Organe zum Einsatz.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Der Unterschied zwischen dem CT- und dem MRT-Verfahren besteht aus technischer Sicht darin, dass bei der Computertomografie Röntgenstrahlen zum Einsatz kommen und aus sehr vielen Röntgenaufnahmen ein 3-D-Volumen – wir sagen Volumendaten dazu – rekonstruiert wird. Die Magnetresonanztomografie ist ein komplett anderes Aufnahmeverfahren: Hier hat man es mit einem starken Hauptmagnetfeld und zusätzlichen Gradientenfeldern zu tun, mit denen die Kernspinresonanz gemessen wird. Mittels Hochfrequenztechnik können auch hier 3-D-Daten gemessen werden, und die Bilddaten werden dann wie bei der CT auf den Bildschirm gebracht.

Das Negative an diesen Darstellungsverfahren ist ja nun, dass wir als Laien auf den Aufnahmen nichts Konkretes erkennen können.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Bis jetzt ist es so, dass Radiologen sehr viel mit Schichtbildgebung arbeiten. Diese Schichtbilder entstehen, indem bei der Ausnahme quasi Schnitte durch den Körper gemacht werden. Aus diesen einzelnen Schichten wird dann die 3-D-Struktur des Körpers rekonstruiert. Radiologen sind natürlich darauf trainiert, aus den Schichtbildern im Kopf die 3-D-Struktur zu rekonstruieren, denn sie wissen sozusagen, wo im Körper sie sich gerade visuell aufhalten, sie haben hier Erfahrungen. Aber für die Patienten, die ja in der Regel Laien sind, ist es sehr schwierig, die Schichtaufnahmen zu interpretieren. Und wir gehen nun mit dem Cinematic Rendering einen großen Schritt weiter und machen die Bilder noch viel verständlicher als vorher.

Können wir bei diesem neuen Verfahren bereits von fotorealistischen Bildern sprechen?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

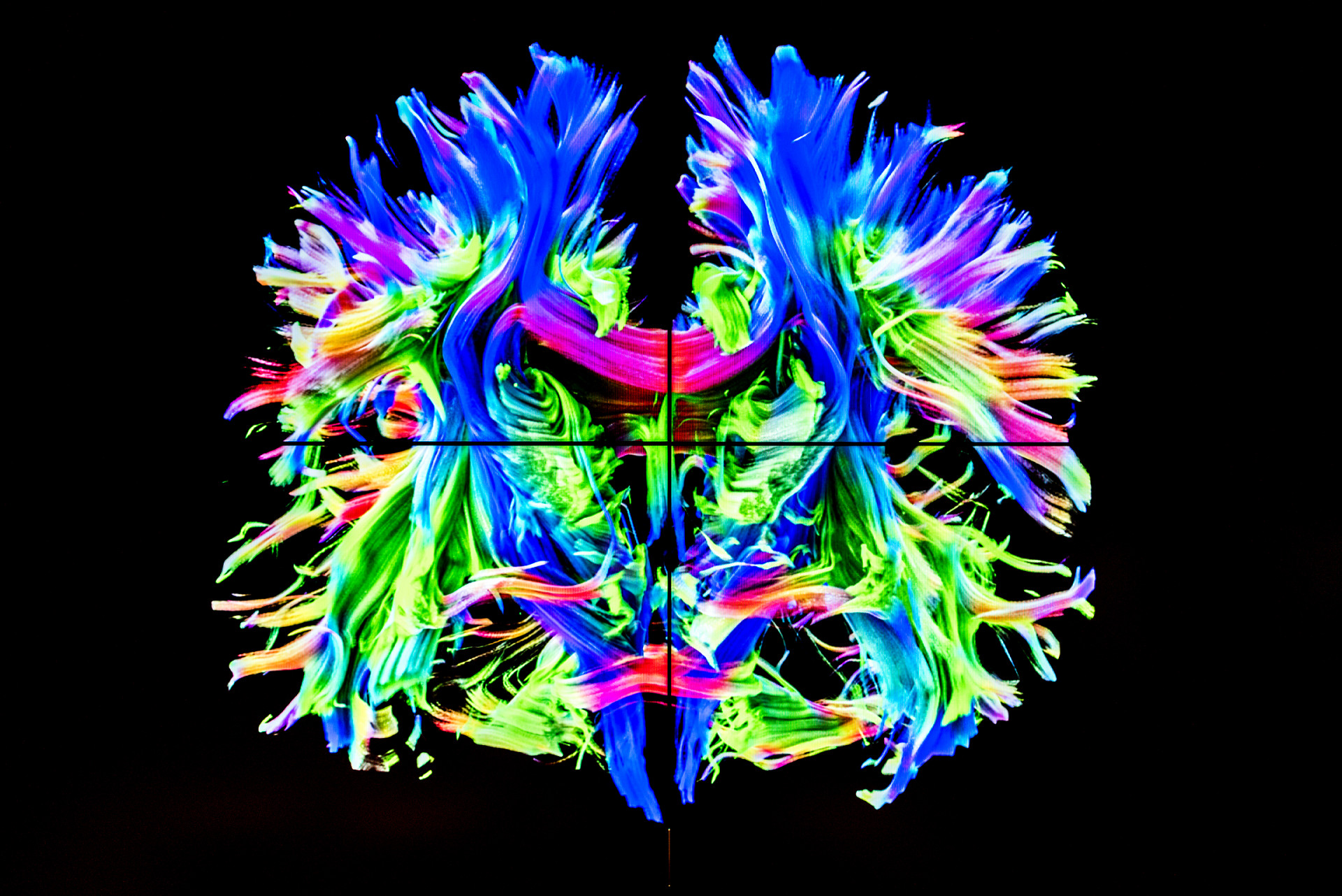

Ja, das ist genau das, was wir versuchen: Mithilfe des Cinematic Rendering wollen wir die Daten so realistisch wie möglich darstellen und sogar darüber hinausgehen. In diesem Zusammenhang hören wir oft den Begriff „Körperwelten“. Wenn Leute unsere Bilder sehen, erinnern sie sich an die Körperwelten-Ausstellungen Gunter von Hagen's vor einigen Jahren, weil unsere Bilder so ähnlich aussehen. Ich würde sogar noch einen Schritt weiter gehen und sagen: Unsere Bilder sind noch weitaus realistischer als die damaligen Exponate, denn bei den Körperwelten-Ausstellungen hatten wir es ja mit toten Menschen zu tun, während beim Cinematic Rendering der lebende Körper abgebildet wird – und zwar nicht nur fotorealistisch, sondern quasi hyperrealistisch, denn wir können die medizinischen Daten in einer Weise darstellen, wie man sie in der realen Welt niemals sehen würde. Wir können zum Beispiel Nervenfasern aus dem menschlichen Gehirn in einer Feinheit darstellen, wie das in der Realität niemals möglich wäre. Zusätzlich zur Anatomie sind selbst rein funktionale Informationen abbildbar, beispielsweise die Stoffwechselaktivität im Körper bei der PET-CT-Bildgebung. In der realen Welt wäre das nicht möglich.

Wie haben Sie das Cinematic Rendering entwickelt? Auf welcher Basis konnten Sie aufbauen?

Dr.-Ing. Robert Schneider

Bei der Frage ist es wichtig, den mathematischen Hintergrund von Volume Rendering zu verstehen, wie es vor Cinematic eingesetzt wurde. Das jetzige Volume Rendering basiert im Prinzip auf der Idee, die komplexen mathematischen Gleichungen, die ein fotorealistisches Rendern beschreiben, durch Approximationen enorm zu vereinfachen. Erst dadurch war es schon sehr früh möglich, mithilfe von Hardware, die noch relativ leistungsschwach war, und Algorithmen, die noch nicht so ausgereift waren wie heute, 3-D-Visualisierungen zu entwickeln.

Prof. Dr. med. Franz A. Fellner

Interessanterweise wurde dieses Verfahren ebenfalls von der Firma Pixar entwickelt.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Und damit spielt auch die Kinoindustrie bei unserem Verfahren eine Rolle. Pixar ist ein Unternehmen, das für seine Computeranimationen wohl jedem Kino-Fan ein Begriff ist. In den 1990er-Jahren hat sich Pixar intensiv mit wissenschaftlicher Visualisierung beschäftigt. Die Firma verkaufte sogar einen Computer, der Volumendaten visualisiert hat, damals auch schon CT-Daten, die dreidimensional dargestellt wurden. Und zu dieser Zeit brachten wir, wie Robert Schneider schon angesprochen hat, ein Verfahren zum Einsatz, das noch sehr vereinfachte Lichtwege approximiert hat.

Grundsätzlich geht man davon, dass sich Licht nur entlang gerader Strahlen ausbreitet – deshalb spricht man auch von Lichtstrahlen. Aber diese Sichtweise ist zu einfach. Wenn wir uns das Licht anschauen, das von außen in einen Raum eintritt, dann muss man es sich wie Billardbälle vorstellen. Die Photonen werden vielfach gestreut, bis sie zufällig auf unserer Netzhaut auftreffen und das Bild erzeugen, das wir jetzt gerade von der Welt wahrnehmen. Und Sie können sich vorstellen, dass eine unermesslich große Anzahl solcher Photonen in diesem Raum unterwegs sind, und die folgen keinen geraden Linien, sondern sehr komplexen Pfaden. Wie Billardbälle werden sie gestreut, immer wieder verändern sie ihre Richtung, und zufällig treffen sie auf ein menschliches Auge. Und nun gehen wir wieder zu unserem Verfahren zurück: Die Raycasting-Methode, die bisher zum Einsatz kam, hat ebenso nur geradlinige Lichtstrahlen verfolgt, während wir mit unserem Verfahren diese komplexen Pfade zugrunde legen. Man kann sich leicht vorstellen, wie unendlich viele dieser Pfade es gibt, die wir verfolgen und berechnen müssen.

Wie ging diese Entwicklung vonstatten? Wer von Ihnen hat was gemacht?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Robert Schneider und ich arbeiten bei Siemens und forschen beide dort schon seit vielen Jahren an der Entwicklung von Volumen-Rendering-Methoden. Viele unserer Algorithmen sind in Produkte eingeflossen, und wir sind permanent darum bemüht, das Volume Ray Casting zu verbessern, und haben im Laufe der Zeit so manche mathematischen Tricks dazu entwickelt. Aber vor ein paar Jahren – es war 2014 – haben wir uns zum ersten Mal überlegt, warum wir es nicht einmal mit einem komplett neuen Verfahren versuchen sollten – einem Verfahren, das weggeht von dieser vereinfachten Idee der geradlinigen Strahlen, hin zum Path-Tracing-Pfad, also zur Lichtpfadverfolgung. Bislang war das ganze Prozedere ja recht mühsam: Jeden einzelnen Trick mussten wir beim Volume Ray Casting hinzufügen. Wenn wir Schatten haben wollten, dann mussten wir die Schatten explizit in das Verfahren hineinprogrammieren. Wenn wir den Effekt erzielen wollten, etwas dunkler erscheinen zu lassen – man nennt das Ambient-Occlusion –, mussten wir dies mit großem Aufwand in den Algorithmus einfügen. Je mehr Effekte man erzielen wollte, desto komplexer, undurchschaubarer und langsamer wurde der Algorithmus.

Dr.-Ing. Robert Schneider

Die Bilder waren zwar dreidimensional, sahen aber immer noch sehr künstlich aus. Vor allem natürlich wirkendes Gewebe, ist extrem schwer zu rendern. Das natürliche Aussehen kommt dadurch zustande, dass das Licht eindringt, unter der Oberfläche vielfach gestreut wird, seine Farbe ändert, also zum Beispiel das Rot des Blutes übernimmt, und an einer anderen Stelle wieder austritt. Genau hier wollten wir mit einem neuen Verfahren ansetzen, das ganz anders arbeitet als das bisherige. Das Schöne an unserer Entwicklung ist, dass wichtige Effekte, die wir aus der Natur kennen, automatisch mit modelliert werden. Die Streuung des Lichts in transparentem Gewebe oder die Ambient Occlusion, von der bereits die Rede war, realistische Schatten und Halbschatten: All diese Effekte sind automatisch mit dabei.

Sie wussten also schon seit Langem, dass die bisherigen Ansätze nicht weit genug gingen, und wollten ein neues Verfahren entwickeln. Was genau war der Auslöser dafür?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Für mich war das Kino der Auslöser. Ich bin begeistert von guter Computergrafik, schaue mir gerne Filme an und sehe natürlich, wie perfekt mittlerweile die Effekte im Kino geworden sind. Charaktere wie Gollum in „Herr der Ringe“ sind perfekt in die Szenen integriert, man erkennt gar nicht mehr, dass es ein digitaler Charakter ist. Da stellt sich die Frage: Warum sollten wir diese Qualität der Darstellung nicht auch in der medizinischen Visualisierung erreichen? Zudem bin ich seit meiner Kindheit von Computerspielen begeistert. Auch dort werden die Effekte immer besser, die Szenen immer realer, und das sollte eigentlich auch in der medizinischen Visualisierung klappen.

Doch in der Medizin sind die Anforderungen natürlich viel höher als im Film. Für die Kinowelt werden die Effekte über Wochen und Monate berechnet, während im medizinischen Einsatz die Bilder sofort, ohne zeitlichen Vorlauf, vorliegen müssen. Das macht es sehr schwer, diese Algorithmen zu entwickeln. Hinzu kommt, dass in der Welt des Kinos und der Computerspiele alle Szenen, die man dort sieht, nur als Oberflächen modelliert sind. Anders ausgedrückt: Der Gollum ist innen hohl, er hat kein Leben, kein Weichgewebe, keine Muskulatur. Deshalb sind die Algorithmen, die dort ablaufen, einfacher, denn man muss das Licht nur an der Oberfläche modellieren und nachvollziehen, wie es mit der Oberfläche interagiert. In der Medizin hingegen arbeiten wir mit volumetrischen Daten, und das Licht kann in das Objekt, in den Körper, eindringen. Die Vorgänge sind hier weitaus komplexer.

Wir sehen sehr plastische, sehr anschauliche Bilder, die vermutlich eine enorme Rechenleistung in einer sehr kurzen Zeit voraussetzen. Ist dies – hohe Leistung in kurzer Zeit – das Geheimnis des Erfolgs bei diesem Projekt?

Dr.-Ing. Robert Schneider

Die Mathematik hinter diesem neuen Ansatz ist natürlich um Größenordnungen aufwendiger als bei den bisherigen Methoden. Wir haben komplett neue Algorithmen entwickelt, mit denen wir die Rechenleistung, die gebraucht wird, dramatisch reduzieren konnten.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Wir brauchen eine Kombination aus zwei Faktoren: Rechenleistung und Algorithmen. Einerseits benötigen wir eine hohe Rechenleistung. Die wurde bereits in den vergangenen Jahren enorm gesteigert. Denken Sie an die Grafikkarten und die Multi-Core-Prozessoren: Was früher die Ausstattung eines Supercomputers war, findet man heute in jedem normalen Desktop-Rechner. Im Ars Electronica Center beispielsweise haben wir heute die 100-fache Rechenleistung des ersten Tera-Flop-Computers aus dem Jahr 1995; der war damals der schnellste Computer der Welt und verbrauchte 500.000 Watt, plus 500.000 Watt zur Kühlung.

Andererseits brauchen wir den richtigen Algorithmus. Sie können sich leicht vorstellen, dass wir beim Thema Licht die Pfade sämtlicher Photonen, die unterwegs sind, nicht berechnen können. So viel Rechenleistung existiert auf der ganzen Welt nicht. Der Algorithmus hingegen wählt sich die wichtigsten Photonenpfade aus und verfolgt sie. Es waren regelrechte algorithmische Durchbrüche nötig, um diese vielen Lichtpfade und vor allem die wichtigsten davon verrechnen zu können. Das hört sich recht trivial an nach dem Motto: Wir müssen halt schauen, wo am meisten Licht herkommt. Aber am Anfang einer komplexen Szene weiß man eben nicht, wo das meiste Licht herkommt, und deshalb sind hier sehr viele Tricks notwendig.

Gelingt die Echtzeitdarstellung nur auf technisch bestens ausgestatteten Computern, oder genügt dafür auch ein normaler PC?

Dr.-Ing. Robert Schneider

Unsere Technik läuft im Prinzip überall, auf einem schwachen Tablet, auf einem Desktop Rechner, auf einem Server, im Rechenzentrum, in der Cloud. Man braucht auch nicht unbedingt eine Grafikkarte. Wenn eine Grafikkarte vorhanden ist, wird sie natürlich verwendet, wenn nicht, läuft der Algorithmus auch effizient nur auf der CPU. Von daher können wir sagen, dass unser Verfahren unabhängig von der Hardware ist.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Ja, das Verfahren funktioniert über alle Geräte hinweg, angefangen beim Smartphone, also vom kleinsten Gerät, bis zur größten Projektion wie im Ars Electronica Center in Linz.

In den ersten Ansätzen hat man den Menschen eher wie eine Skizze gesehen, und mit dem neuen Verfahren ist das Bild nun plastisch und realistisch. Wie kann man den Unterschied beschreiben?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Vorher sahen die Bilder in der Tat ein bisschen stilisiert aus, so wie ein Comic, ein Zeichentrickfilm. Die heutigen Bilder hingegen bilden das Objekt wirklich ab, so wie in den bereits erwähnten Körperwelten-Ausstellungen. Teilweise fragen uns die Leute auch: Ist das wirklich ein computererzeugtes Bild oder doch eine Fotografie?

Prof. Dr. med. Franz A. Fellner

Ja, der Vergleich mit Zeichentricktechnik früher und moderner Animation heute, wie wir es aus dem Kino kennen, ist zutreffend. Daran kann man ersehen, wie groß der Qualitätssprung vom alten zum heutigen Verfahren ist.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Ganz wichtig bei diesen neuen Möglichkeiten sind die Tiefenwahrnehmung auf der einen Seite und die Formwahrnehmung auf der anderen Seite. Beides wurde verbessert. Zunächst zur Tiefenwahrnehmung – man spricht auch von der Schattierung: Unsere Augen und unser Gehirn sind von Geburt an darauf trainiert, die kleinsten Schattierungsnuancen zu interpretieren und daraus die Tiefe eines Objekts zu berechnen. Selbst wenn Sie nur ein zweidimensionales Bild sehen, können Sie die Tiefe des Objekts einschätzen, weil man genau die Schattierungsunterschiede erkennt. Auch die Formwahrnehmung wird durch kleine Schattierungsunterschiede gestützt, und dadurch werden die Formen viel deutlicher. Man kann erkennen: Das hier ist ein rundes Objekt, das hier ein flaches.

Wie lange dauerte der Entstehungsprozess? Die ersten Schritte wurden ja bereits im Jahr 1999 gemacht.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Unser eigenes Projekt begann erst 2014, als wir den Umstieg wagten.

Das war aber dann die zweite Phase, oder?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Es ist so: Robert und ich arbeiten schon seit langer Zeit an der Entwicklung volumetrischer Darstellungen. Ich beschäftige mich seit circa 1998 mit dem Thema Volume Rendering, Robert war im Bereich der geometrischen Modellierung tätig. Über die Jahre haben wir beide dann das traditionelle Ray-Casting-Verfahren immer weiter verbessert und hier auch enorme Fortschritte gemacht. Auch die Art der Darstellung konnten wir verbessern. Doch der wirkliche Umstieg auf dieses komplett neue Verfahren fand um das Jahr 2014 statt.

Dr.-Ing. Robert Schneider

Ich beschäftigte mich während meiner Promotion mit geometrischer Modellierung. Da ich eigentlich Mathematiker bin, empfand ich die geometrische Modellierung als mathematisch anspruchsvoller. Mit Volume Rendering befasse ich mich seit 2001, also seit ich bei Siemens angefangen habe.

Welchen direkten Nutzen hat das neue Verfahren? Bisher brauchte man einen gut geschulten Radiologen, um zu erkennen, was auf medizinischen Aufnahmen zu sehen ist. Was verändert sich jetzt durch Ihre Methode?

Prof. Dr. med. Franz A. Fellner

Im Bereich der Knochen, wo dieses Verfahren sehr gut funktioniert, kann man vor allem komplizierte Frakturen auf einfache Weise ganz klar und auch für den medizinischen Laien sehr verständlich darstellen. Auch Besprechungen zwischen den verschiedenen Fachärzten, etwa Radiologen und Chirurgen, speziell Unfallchirurgen, werden erleichtert, weil die Knochen und damit auch Brüche und andere Verletzungen dreidimensional dargestellt werden. Ein weiteres interessantes Einsatzgebiet sind die Gefäße, weil man sie in einem sehr guten Kontrast betrachten kann. Hiervon profitieren zum Beispiel Gefäßchirurgen oder Vertreter der interventionellen Radiologie. Und auch für den Patienten selbst bringt unser Verfahren viele Vorteile: Man kann ihm anhand anschaulicher Bilder zeigen, an welcher Krankheit er leidet, was wie operiert wird, er versteht den Befund, und die Kommunikation zwischen ihm und den behandelnden Ärzten wird wesentlich einfacher.

Vereinfacht das Verfahren auch die Kommunikation der Ärzte untereinander, zum Beispiel während einer Operation? Nehmen wir den Fall, dass sich bei einer Tumoroperation herausstellt, dass die Geschwulst viel größer ist als ursprünglich angenommen. Leistet hier Ihre Methode Hilfestellung?

Prof. Dr. med. Franz A. Fellner

Greifen wir diesen Beispielfall auf. Grundsätzlich erhält der Operateur die Informationen, die er für den Eingriff benötigt, vom Radiologen, und vor der Operation schaut er sich die Aufnahmen nochmals genau an. Er erlebt also in der Regel keine Überraschung dahingehend, dass der Tumor in der Realität deutlich größer ist als auf den Aufnahmen. Schwieriger ist die Situation schon eher, wenn wir uns die Beziehung des Tumors zu den Gefäßen anschauen. Hier gibt es in der Tat viele unterschiedliche Varianten: Wie viele Gefäße hat der Patient an der fraglichen Stelle? Wie kräftig sind sie? Laufen sie um den Tumor herum oder in ihn hinein? Aber auch hier leistet die Bildgebung Großartiges, bildet viele Einzelheiten dreidimensional ab, und echte Überraschungen beim Öffnen des Körpers sind bei unserem Verfahren im Prinzip nur sehr selten. Noch eine Bemerkung zu den Gefäßen: Unsere Methode leistet auch in der Neurochirurgie gute Dienste, und wir werden in absehbarer Zeit spezielle Schulungen für Neurochirurgen anbieten.

Sie haben uns aufgezeigt, dass Mediziner von Ihrem Verfahren sehr profitieren. Wie sieht das mit der medizinischen Ausbildung allgemein aus? Ist Ihr Verfahren auch hier hilfreich?

Prof. Dr. med. Franz A. Fellner

Auf jeden Fall. Nehmen wir zum Beispiel das Sezieren von Leichen im Medizinstudium. Naturgemäß sind einzelne Dinge bei einem toten Körper nicht so gut erkennbar wie bei einem lebenden Menschen. So fehlt beispielsweise das Blut, das die Gefäße füllt, es fehlen die anderen Körperflüssigkeiten, vor allem das Wasser, und wir Menschen bestehen immerhin zu 60 bis 70 Prozent aus Wasser. Leere Gefäße sind schwerer zu identifizieren als volle. Hier leistet unsere Methode eine große Hilfestellung. Ein weiterer Punkt ist, dass unsere Methode zerstörungsfrei arbeitet. Wenn Sie bei der Präparation einer Leiche zum Beispiel versehentlich einen Nerv durchschneiden – und so etwas passiert durchaus –, dann ist dieser Nerv unwiederbringlich weg. Es gibt ihn nicht mehr. Wenn Sie einen Muskel entfernen, existiert er nicht mehr, Sie müssen dann mit dem weiterarbeiten, was übrig bleibt. Anders ist das in der virtuellen Anatomie: Hier wird nichts zerstört. Ein anderer Vorteil unseres Verfahrens ist: Wir können Strukturen vergrößern und verkleinern, wir können in Elemente Bewegung hineinbringen, uns sozusagen um den ganzen Körper drehen oder, wenn es uns interessiert, Teile des Körpers drehen. Um eine dreidimensionale Struktur zu verstehen, muss man sie drehen. Es reicht nicht, sich nacheinander Einzelbilder anzuschauen, vielmehr muss man sie bewegen.

Und noch ein weiterer Punkt: Mit unserem Verfahren kann man auf einen Schlag das komplette Skelettsystem darstellen. Bei einer Leiche geht das nicht. Nur bei dreidimensionalen, klaren Aufnahmen können Sie Strukturen nachverfolgen. Knochen nachverfolgen, Gefäße nachverfolgen, von oben bis unten.

Hinzu kommt: Als Lehrender muss man immer mit der Zeit gehen. Jede Generation hat ihre Eigenheiten, und die Generation, die jetzt studiert oder noch zur Schule geht, lebt mit iPads, mit Smartphones. Die jungen Leute arbeiten heute interaktiv, sie zoomen, sie drehen, sie sind das so gewohnt, und ihr Hippocampus wird entscheiden, was wir jetzt lernen. Der braucht immer wieder Reize – und in der Welt dieser Generation unterrichten wir. Bei der Ausbildung der Medizinstudenten wechseln wir die verschiedenen Dichte- und Intensitäts-Levels, das heißt, wir zeigen die Haut von außen, dann das Muskelsystem und schließlich das Skelett und die Gefäße sowie die inneren Organe. Das ist jetzt alles viel interessanter und lehrreicher als beim Sezieren einer Leiche allein.

Und wir haben ja noch andere Gesundheitsberufe außer den Ärztinnen und Ärzten, die niemals an einem toten Körper lernen können. Wir kennen Physiotherapeuten, die schon seit Jahren im Geschäft sind und gerne an Anatomievorlesungen teilnähmen, weil es ihnen helfen würde, Strukturen besser zu verstehen. Und genau das setzen wir mit Cinematic Rendering in der Ausbildung dieser Gesundheitsberufe in Linz bereits routinemäßig um. 24 Lehrveranstaltungen haben bereits stattgefunden, und die neuen Termine stehen schon fest. Sanitäter brauchen immer wieder eine Anatomieauffrischung, und das nicht nur in der Ausbildung, sondern in ihrem täglichen Beruf. Auch Krankenschwestern, Pfleger, Physiotherapeuten oder Osteopathen haben mit unserem Verfahren die Möglichkeit, Anatomie so zu sehen, wie sie tatsächlich ist, und sie virtuell zu begreifen.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Wir hatten auch in der diagnostischen Bildgebung schon Fälle, in denen man auf den Cinematic-Bildern Dinge sieht, die im Schichtbild nicht erkennbar sind.

Prof. Dr. med. Franz A. Fellner

Auch bei uns gab es einen ähnlichen Fall, der so noch nicht publiziert ist. Da hat man im Cinematic Rendering eine Unterkieferfraktur entdeckt, die in Schichtbildern nicht zu sehen war.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Viele Radiologen haben da ihre eigene Meinung. Sie behaupten, dass sie auf Schichtbildern mehr sehen als bei Cinematic-Rendering-Aufnahmen, und wollen deshalb immer nur mit Schichtbildern arbeiten. Diese haben schon Vorteile: Wenn man im Gegensatz zur 3-D Darstellung auf Schichten schaut, dann hat man nichts, was die Schicht verdeckt, man sieht alles, was in der Schicht drin ist. Die gleichen Daten benutzen wir aber auch für die 3-D-Darstellung. Auch diese hat Vorteile: Nehmen wir nochmals den von Herrn Fellner geschilderten Fall mit der Unterkieferfraktur: Hier haben allein die realistischen Lichteffekte diese Mikrofraktur gezeigt. Es gibt also wirklich Fälle in der diagnostischen Bilddarstellung, bei denen das Cinematic Rendering Vorteile hat.

Prof. Dr. med. Franz A. Fellner

Ich möchte gerne noch ein anderes Beispiel anführen: Wenn man am Kopf operiert und den Schädel eröffnen muss, ist sehr wichtig zu wissen, wie der Knochen dort beschaffen ist, wie dick oder dünn er ist. Der Knochen kann bei jedem Menschen völlig unterschiedlich dick oder dünn sein. Zudem gibt es Kanäle, aus denen Blutgefäße herauskommen, da darf man nicht hineinschneiden, weil man sie sonst verletzen würde und es zu Blutungen kommen kann. Dies alles plastisch zu sehen wie bei dem neuen Verfahren ist für die Planung operativer Eingriffe am knöchernen Schädel sehr wichtig.

Wie ist Ihre Zusammenarbeit entstanden? Hat der Techniker gesagt: Ich brauche jetzt den Mathematiker, um den Algorithmus aufzusetzen?

Dr.-Ing. Robert Schneider

Wir kennen uns bereits seit der Promotion, wir mussten uns nicht gegenseitig suchen.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Ja, wir kennen uns schon lange und sind auch schon viele Jahre Kollegen. Ich habe 2014 den ersten Prototypen entwickelt; bis dahin war es ja unmöglich, so etwas in Echtzeit auf einem normalen Computer zu rechnen. Robert hatte das Thema „Volume Rendering“ auch auf seinem Radar, aber damals noch keinen Prototypen dazu erstellt. Deshalb mussten wir uns nicht extra für die Zusammenarbeit an diesem Projekt synchronisieren.

Dr.-Ing. Robert Schneider

Klaus hatte die ersten Bilder präsentiert, und das war für mich der Auslöser. Ich sehe das Ganze ja naturgemäß aus der Sicht des Mathematikers. Das jetzige Volume Rendering, das war eine Approximation an das fotorealistische Rendering. Es war schon immer ein Traum von mir, irgendwann einmal medizinische Daten fotorealistisch zu rendern. Die Frage war für mich nur: Wann ist dieser Zeitpunkt da? Wann ist die Hardware ausgereift, wann sind die Algorithmen weit genug? Als ich dann die Bilder von Klaus gesehen habe, hat es bei mir sofort Klick gemacht, und ich habe gewusst: Das ist es! Jetzt ist die Zeit gekommen, jetzt können wir das anpacken.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Genauso war es, und so ergänzen wir uns sehr gut. Robert bringt eher das Mathematische, Analytische mit, schaut sich die Algorithmen, die Mathematik im Detail an, versteht, wie man etwas mathematisch korrekt modellieren und beschreiben kann. Ich habe eher die Herangehensweise eines Computergrafikers, was man etwa von der Spielewelt und auch von der Kinowelt her kennt, wo es darum geht, wie man etwas so hintricksen kann, dass es möglichst gut aussieht. Ich glaube, die Kombination dieser beiden Sichtweisen ist es, was uns vorangebracht hat. Ich habe eher den künstlerischen und ästhetischen Blick auf die Sachen, während Robert den analytischen Blick mitbringt und die Verfahren genau analysiert.

Und dann stießen Sie als derjenige hinzu, der das Ganze in der Praxis einsetzt und vorstellt?

Prof. Dr. med. Franz A. Fellner

Richtig. Im Sommer 2015 kam Siemens auf uns zu und sagte, sie hätten da eine neue Nachverarbeitungstechnik im Bereich High-End-Visualisierung. Das ist auch das Arbeitsgebiet des Ars Electronica Centers in Linz, Österreich, eines Hightech-Museums der Kunst, Technologie und Gesellschaft, und mittlerweile sehr stark der Life Sciences. Hinzu kam, dass man wusste, dass ich mich mit virtueller Anatomie beschäftige. Unter diesem Begriff kann man sich viel vorstellen, etwa ein Röntgenbild, die Aufnahme eines Computertomografen oder eine Vorlesung im Fach Anatomie unter Verwendung von computer-generierten Grafiken. Aber echte virtuelle Anatomie hat mit dreidimensionaler Aufbereitung zu tun. Damit hatten wir uns im Ars Electronica Center bereits beschäftigt. Das Ars Electronica Future Lab hatte früher schon ein Volume-Rendering-Programm geschrieben, mit dem wir schon das eine oder andere Objekt dreidimensional darstellen konnten. Das war für die damalige Zeit zwar schon gut, doch Cinematic Rendering ist eine ganz andere Nummer. Doch es gab auf diesem Gebiet durchaus gute Vorarbeiten, und im Juli 2015 fand dann die Installation des Cinematic Rendering von Siemens statt, und wir sind offiziell gestartet. Mein Wunsch damals war, dass das Ganze auch noch in 3-D funktioniert – und dann hatten wir plötzlich dieses Cinematic Rendering auf 16 mal 9 Metern auch in 3-D. So sind wir zusammengekommen, und im September sind wir dann erstmals miteinander öffentlich aufgetreten.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Seitdem haben wir auch sehr viele Shows und Präsentationen zusammen gemacht. Wir haben sehr viel miteinander gearbeitet und wertvollen Input von Prof. Fellner bekommen, etwa was die Interaktionen und Datensätze angeht, wie man Kontraste einstellt oder welche Beleuchtung man wählt – eben alles, was man braucht, um Anatomie so einfach darzustellen, dass jeder sie versteht. Das war eine ganz wertvolle Zusammenarbeit.

Prof. Dr. med. Franz A. Fellner

Dazu ein paar Zahlen: Seit unserem Start sind jetzt fast zwei Jahre vergangen, es fanden weit über 100 Vorstellungen statt, und demnächst erwarten wir den 15.000sten Besucher.

Wenn wir die Innovation im Hinblick auf eine wirtschaftliche Vermarktung sehen – wo stehen Sie jetzt?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Wir haben unser Verfahren zunächst einmal in unserer Forschungsplattform umgesetzt. Es ist schwierig, Algorithmen sehr schnell in die praktische Anwendung zu bekommen. Zunächst müssen noch viele Abnahmen folgen, etwa durch die Food and Drug Administration (FDA) in den USA. Die FDA hat sehr strenge Regularien, wann Softwareprodukte auf den Markt und in die praktische Anwendung kommen dürfen. Als wir den initialen Prototypen hatten, integrierten wir zunächst unseren Algorithmus in unsere Forschungsplattform. Das erlaubt es uns, solche Forschungsprototypen schnell in die klinische Praxis übertragen zu bekommen, um rasch Feedback zu erhalten. Prof. Fellner hat in der Klinik eine Workstation, mit der er uns sehr schnell Rückmeldung geben konnte, wie weit das Verfahren einsetzbar ist. Es geht dabei um Fragen wie diese: Ist die Methode, was das Rendern betrifft, schnell genug? Sind die Interaktionsmechanismen in Ordnung? Erfüllen wir die erwartete Darstellungsqualität? Für welche Bereiche ist das Verfahren anwendbar? Worin liegt letztlich der Mehrwert?

Die zweite Umsetzung erfolgte im Herbst vergangenen Jahres, als wir das Verfahren voll in unsere syngo.via-Plattform integriert haben. Das ist unsere medizinische Nachverarbeitungsplattform. Das heißt, Kunden, die eine Syngo-Workstation besitzen, haben jetzt die Möglichkeiten, auf dieses neue Verfahren zuzugreifen. Sie können es sich so vorstellen: Wenn Sie einen CT-Scanner oder einen MR-Scanner kaufen, bekommen Sie eine Nachverarbeitungs-Workstation mitgeliefert. Sie wollen die Daten ja auch bearbeiten können, die aus dem Scanner kommen. Das ist eine Workstation mit professionellem Computer, und auf dem läuft eine Software, genannt „syngo.via“, eine Art Photoshop für medizinische Daten, auf denen man nun die Möglichkeit habt, derartige Bilder zu erzeugen.

Ihr System baut also auf der Magnetresonanztomografie und auf der Computertomografie auf.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Genau, es läuft mit CT-Daten, MRT-Daten, Ultraschall-Daten – kurz: mit allem, was volumetrische Daten liefert.

Bedeutet das, dass man bestehende Ausrüstungen beziehungsweise deren Output mit Ihrer Innovation aufrüsten kann?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Das ist wirklich ein ganz entscheidender Punkt: Wir brauchen lediglich eine Aufrüstung, denn wir können alte Daten, die vor zehn Jahren oder vor über 15 Jahren aufgenommen wurden, mit dem neuen Verfahren darstellen. Das ist auch unabhängig von dem Hersteller, der die Daten produziert hat. Das heißt: Auch wenn man einen medizinischen Scanner eines anderen Herstellers hat, können die Daten – das ist ja ein reines Software-Upgrade und damit natürlich auch kostengünstig – in den Arbeitsprozess integriert werden. Bei Software kann man also durch Upgrades Systeme ganz leicht um Klassen stärker machen: Update einspielen, und dann hat man plötzlich die Möglichkeit, Daten in dieser Art darzustellen. Man braucht keine neuen Protokolle, also keine neue Aufnahme – Sie müssen niemanden trainieren, Daten aufzuarbeiten. Bei Hardware hingegen ist das schwieriger, man muss das ganze System austauschen, und das wird richtig teuer.

Das Verfahren ist jetzt in unserer Standardapplikation produktisiert, also vorab fest als Dienstleistung definiert, und damit allen unseren Kunden zugänglich. Wir haben eine große Installationsbasis bei unseren Geräten und der Syngo-Software.

Und jetzt geht es natürlich weiter. Wir wollen vor allem Chirurgen beraten und ihnen die Visualisierung zugänglich machen – Stichwort Cloud Computing. Das ist ein sehr interessanter Aspekt, dass jedermann, auch der Patient selbst, seine Daten auf diese Weise visualisieren kann. Nehmen wir an, Sie hatten einen Skiunfall, bekommen ein Rendering auf CD oder auf einem Memory-Stick und können selbst Bilder erzeugen, etwa als Service. Wir arbeiten ja, wie bereits erwähnt, mit dem Ars Electronica Center zusammen, wo für Anatomievorlesungen, also für den Bildungsbereich, die Software weiterentwickelt werden kann. Es gibt hier ein ganz großes Potenzial, wie sich das System noch weiter verbessern lässt.

Gibt es Wettbewerb auf Ihrem Gebiet? Sehen Sie Konkurrenz?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Es gibt aktuell niemanden auf dem Markt, der etwas Vergleichbares liefern kann. Im Ultraschallbereich laufen schon seit einigen Jahren bestimmte Entwicklungen, bei denen man versucht hat, Ultraschalldaten, zum Beispiel einen Embryo im Mutterleib, möglichst realistisch darzustellen. Dazu haben wir selbst – ich glaube, es war 2007 – eine Lösung auf den Markt gebracht. Ein Konkurrent schafft es hier, solche Ultraschalldaten ebenfalls ziemlich realistisch darzustellen. Hier gibt es also einen gewissen Wettbewerb, aber wenn es darum geht, allgemeine Volumendaten aus jeder Art von medizinischer Modalität zu bekommen, sehen wir zurzeit auf dem Markt nichts Vergleichbares.

Wie sehen Sie die weitere Entwicklung? Der Chirurg steht am Operationstisch, vor sich den Patienten, und er kann gleichzeitig via Cinematic Rendering in Echtzeit sehen, was er tun sollte. Ist das Ihre Vision?

Prof. Dr. med. Franz A. Fellner

Eine Vision ist Virtual Reality. Zwar liegen die Brillen, die jetzt am Markt sind, wie etwa die HoloLens, noch etwas schwer auf der Nase, und man hat ein eingeschränktes Gesichtsfeld. Doch in den nächsten Jahren werden sie verbessert und damit praktikabel sein. Für bestimmte Aufgaben kann es interessant werden, im Operationssaal Bilder in transparenten Brillen im Cinematic Rendering darzustellen. Das könnte zum Beispiel dem Chirurgen helfen, bei Operationen am Schädel die Knochenschnitte optimal zu setzen und damit das Komplikationsrisiko noch weiter zu verringern.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Dazu haben wir schon erste Vorarbeiten im OP-Bereich in Linz unternommen – Stichwort Lightmaps. Es wurde eine Panoramaaufnahme gemacht, womit wir die Beleuchtungsumgebung, das Licht im OP-Saal, eingefangen haben, so wie es von allen Seiten am Operationstisch ankommt. Jetzt können wir präoperativ aufgenommene Daten in den Raum schicken und dem Chirurgen eine Vorstellung davon geben, wie sein Patient während der Operation aussehen wird. Und in diese Richtung wird die Entwicklung weitergehen.

Gibt es einen Zeithorizont für diese Entwicklung? Kann man das abschätzen?

Prof. Dr. med. Franz A. Fellner

Das ist schwer abzuschätzen, aber wenn das zutrifft, was technisch vorausgesagt wird – dass die Technik in den nächsten zwei bis fünf Jahren so weit ist –, dann wird die Nutzung sehr stark zunehmen. In Spezialinstituten oder Universitäten kommt das Verfahren ja bereits zum Einsatz, aber der Anwendungsbereich könnte künftig deutlich in die Breite gehen.

Dr.-Ing. Robert Schneider

Eine Lösung für einen Virtual-Reality-Monitor könnte ich mir in viel kürzerer Zeit vorstellen, vielleicht schon in ein oder zwei Jahren, denn hier ist die Hardware schon viel reifer als bei den VR Brillen. Für Virtual-Reality-Anwendungen im Allgemeinen haben wir sogar schon sehr beeindruckende Prototypen mit Echtzeit-Cinematic-Rendering.

Nochmals zurück zur Realität heute. Hat ihr Produkt eine Zulassung als Medizinprodukt?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Unser Forschungsprototyp ist in der Tat nicht klinisch zugelassen. Dieser dient dazu, eine schnelle Rückmeldung aus der Praxis zu bekommen. Klinisch darf er aber nicht eingesetzt werden. Inzwischen ist das Verfahren aber in unsere klinisch zugelassene Plattform syngo.via integriert und damit als Medizinprodukt zugelassen.

Fassen Sie an dieser Stelle doch bitte kurz zusammen: Was ist das Innovative an Ihrem Projekt, das jetzt bereits mit der Nominierung zum Deutschen Zukunftspreis gewürdigt worden ist?

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Das Innovative an unserem Projekt ist, ein neues Darstellungsverfahren für medizinische Bilddaten entwickelt und dieses in die klinische Praxis gebracht zu haben, was bisher undenkbar in der Umsetzung war – und – dieses auf normalen Computern und sogar Tablets in Echtzeit zum Laufen bekommen zu haben. Dazu waren vielerlei algorithmische Optimierungen nötig. Wir haben eine Bildqualität erreicht, die eine Vielzahl neuer Einsatzmöglichkeiten erlaubt, sei es in der Anatomielehre, der Patientenkommunikation, der OP-Planung oder mit der spezielle diagnostische Fragestellungen beantwortet werden können. Das Verfahren ist aber so flexibel, dass sich viele weitere Anwendungen, auch außerhalb der Medizin gezeigt haben, die wir am Anfang noch nicht bedacht hatten.

Jetzt noch einige persönliche Fragen. Was hat Sie seinerzeit gereizt, diesen Berufsweg – hier: die Kombination von Technik und Medizin – zu wählen? Und gab es in Ihrer Ausbildung oder im Studium Menschen oder besondere Ereignisse, die Sie beeinflusst haben?

Dr.-Ing. Robert Schneider

Bei mir lief es zu einem großen Teil wie bei Klaus, wie er vorhin erzählt hat. Ich habe mir schon als Jugendlicher einen C64 zugelegt und mich immer gefragt, wie die Spiele, mit denen ich beschäftigt war, zustande kamen, wie man die programmiert. So bin ich dann zur Programmierung und zur Informatik gekommen. Und es gab noch einen zweiten Grund: Ich habe mich schon sehr früh für Mathematik interessiert. Dort kann man die wenigsten Probleme analytisch, also exakt auf dem Papier, lösen, sondern man braucht numerische Verfahren, und für numerische Verfahren braucht man Computer, und die muss man wiederum programmieren können. Diese Kombination aus beidem hat mich zur Informatik gebracht.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

In den 1980er-Jahren musste man sich bei einem kleinen Home-Computer wirklich in die Tiefen hineinarbeiten, um das Letzte aus ihm rauszuholen. Man bewegte sich auf Low-Level-Ebenen und musste viel Zeit in die Optimierung, in die Algorithmen investieren, um das Ganze zu verstehen. Im Prinzip funktioniert das heute noch genauso, wenn wir uns fragen, wie wir aus unseren modernen Rechenmaschinen das Optimum herausholen können, um Verfahren wir das unsere überhaupt realisieren zu können. Denn ohne die ganzen Optimierungsarbeiten, die Verbesserung der Algorithmen und auch die Nutzung der zur Verfügung stehenden Hardware und Rechen-Power wäre das Verfahren völlig undenkbar.

Dr.-Ing. Robert Schneider

Früher, beim C64, lief der mit Abstand schnellste Code mit Maschinensprache. Wäre eine neue Hardware herausgekommen, dann wäre auch der Code nicht mehr brauchbar gewesen. So könnten wir heute in Produkten nicht arbeiten. Jedes Jahr kommen neue Prozessoren auf den Markt, mit neuen Vektor-Befehlssätzen, die massiv beeinflussen, wie sie programmiert werden müssen. Wir müssen heutzutage die Software so schreiben, dass man einerseits das Optimum an Performance herausholen kann, sie aber andererseits auch in der nächsten Hardwaregeneration noch lauffähig ist. Dabei können wir natürlich nicht einen gigantischen Programmieraufwand quasi wegwerfen und neu anfangen. Es gibt einen Trade-off, den man erfüllen muss.

Gab es bei Ihnen jemanden, der Sie an die Hand genommen und beeinflusst hat?

Dr.-Ing. Robert Schneider

Mich hat die Technik an sich beeinflusst, der C64 und mein mathematisches Interesse. Mathematik macht mir einfach Spaß. Ich habe dann auch dieses Fach studiert – nicht für das Lehramt, sondern für das Mathe-Diplom als Abschluss. Viele meiner damaligen Lehrer konnten das nicht verstehen und meinten, das sei doch kein richtiges Fach, auf dem man einen Beruf aufbauen kann. Ich solle doch besser Ingenieur oder Informatiker werden, dann wisse jeder, was ich beruflich mache. Aber ich bin bei der Mathematik geblieben und habe es nie bereut.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Mathematik spielt auch in der Computergrafik eine enorme Rolle, es liegt eine gewaltige Schönheit in der Mathematik. Ich beschäftige mich auch privat mit Fraktalen, und es fasziniert mich, aus welchen einfachen mathematischen Berechnungen dort unglaubliche Bilder, Strukturen und Formen entstehen.

Und wie lief es bei Ihnen? Sind Sie erst zur Medizin gekommen und dann zu den Bildern?

Prof. Dr. med. Franz A. Fellner

Die Begeisterung für das Medizinische stammt von meiner Mutter. Sie wäre gerne Krankenschwester geworden, durfte es aber nicht, und ihr Interesse an der Medizin hat mich von Kindesbeinen an beeinflusst. Später, in der Schule und vor allem auf dem Gymnasium, kam dann das Interesse für Sprachen, für Geschichte und sehr stark auch für Technik dazu, die sich in den 1970er-Jahren rasant weiterentwickelte. In der Medizin und in der Technik gibt es ein großes Weiterentwicklungspotenzial, und sehr schnell ging es bei mir dann in Richtung Radiologie.

Was macht Ihren Beruf heute so spannend? Was könnte einen jungen Menschen dazu bewegen, sich für eine solche Fachrichtung zu entscheiden? Was ist das Essentielle Ihres Berufes?

Dr.-Ing. Robert Schneider

Das Essentielle ist: Ich habe die Freiheit, mir Algorithmen und Lösungswege für jene Probleme auszudenken, von denen man erfährt, wenn man mit einem Chirurgen oder Radiologen spricht. So entsteht ein Interesse, hier zu helfen. Dann macht man sich Gedanken darüber, wie man das Problem analytisch fassen kann und welche Möglichkeiten es gibt, die Probleme zu lösen. Solche Tüfteleien auszuarbeiten empfinde ich als sehr befriedigend.

Sie haben demnach einen sehr hohen Freiheitsgrad bei der Umsetzung Ihrer Arbeit …

Dr.-Ing. Robert Schneider

Da muss man differenzieren. Klaus und ich sind, das muss man zugeben, schon ein wenig privilegiert. Wir haben wahrscheinlich mehr Freiheiten als viele unserer Kollegen. Unabhängig davon ist es auch immer wieder toll, die positiven Reaktionen zu erleben. Hat einem zum Beispiel ein Radiologe ein Problem geschildert, und wir präsentieren ihm dann mit dem Echtzeit-Cinematic-Rendering die Lösung, dann ist die Freude groß, und dieses Feedback beflügelt einen zum Weitermachen.

Welche Reaktionen bekommen Sie auf Ihre Lehrveranstaltungen zum Cinematic Rendering?

Prof. Dr. med. Franz A. Fellner

Sehr gute. Es kommen sehr viele Besucher, vom vierjährigen Kind über Erwachsene bis hin zu Fachleuten aus der Wissenschaft, aus der Medizin, aus den verschiedensten Fächern. Hinzu kommt: Wenn irgendein Kongress in Linz stattfindet, seien es Internisten, Gynäkologen oder Ärzte anderer Gebiete, buchen sie immer eine Stunde „Deep Space“ als Fortbildungsveranstaltung im Kongress. Also auch von dieser Seite erhalten wir Rückmeldung.

Wie ist das eigentlich, wenn Kinder diese realistischen Bilder des menschlichen Körpers in allen Einzelheiten anschauen? Kinder haben ja eine natürliche Neugier, aber es ist doch sicherlich kein ganz einfaches Thema für sie.

Prof. Dr. med. Franz A. Fellner

Ich habe mich von Anfang an gewundert, dass so viele Kinder zu den Veranstaltungen kommen und Eltern gezielt ihre Kinder mit hineinnehmen. Erst kürzlich hatten wir an einem Samstag drei Vorstellungen mit über 600 Leuten, und es waren viele Kinder dabei. Ich glaube, Eltern dürfen ihre Kinder niemals unterschätzen. Wenn Eltern wollen, dass ihre Kinder bestimmte Dinge nicht anschauen, sind Verbote meist nutzlos, denn die Kinder haben das meist schon längst gesehen, sie sind irgendwie rangekommen. Was es bei unseren Veranstaltungen zu sehen gibt, ist für Kinder einfach nur schön. Es ist groß, es ist bunt, es bewegt sich, es ist interessant, und sie greifen auch danach. Das gefällt ihnen. Das Ganze ist also völlig unproblematisch. Wenn man, wie wir, mehr als 100 Veranstaltungen durchgeführt hat, dann weiß man vorher, an welcher Stelle und bei welchen Bildern das Publikum raunt, wann es lacht. Viele, die unsere Aufnahmen zum ersten Mal sehen, sagen: Das sieht nach Körperwelten aus. Dann sage ich: Ja, ist es auch, nur sind es bei uns lebende Körperwelten. Der Unterschied ist: Die Menschen, deren Körper wir bei unseren Vorstellungen sehen, leben, und es geht ihnen gut. Wir müssen uns von der Vorstellung verabschieden, dass das gruselig ist. Bisher haben die Leute gedacht: Wenn man einen Menschen so sieht, dann ist er tot. Doch das stimmt nicht mehr: Was wir hier sehen, ist das, was in uns drinsteckt, es zeigt uns so, wie wir tatsächlich sind. Äußerlich unterscheiden wir uns durch Körpergröße, durch Körpervolumen, durch Behaarung voneinander, doch innen drin schauen wir ziemlich identisch aus. Es gibt zwar leichte Varianten, aber bei denen muss bereits der Spezialist genau hinsehen. Ansonsten schauen wir alle gleich aus. Wenn man sich das vor Augen hält, ist der Anblick nicht mehr gruselig. Und Kinder empfinden das ohnehin nicht so.

Technik und Medizin in einem Verfahren zusammenbringen – wie kreativ ist das, was Sie tun?

Dr.-Ing. Robert Schneider

Es ist sehr kreativ, sich komplexe Algorithmen auszudenken. Ich kann mir kaum etwas Kreativeres vorstellen. Mathematik ist per se sehr kreativ. Und Programme so zu schreiben, dass sie die Hardware optimal ausnutzen und trotzdem lesbar sind, ist für mich sogar Kunst.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Ich konnte mich aber nie mit den normalen Werkzeugen anfreunden, die man im Regelfall benutzt, also mit Stiften oder Kreide oder Ähnlichem. Für mich ist auch der Computer ein Werkzeug, seine Kreativität auszuleben, und so hat es mir der Computer ermöglicht, kreativ zu sein und jetzt fast künstlerische Bilder zu erschaffen. Ich habe nun die Möglichkeit, solche Bilder zu machen und sie ästhetisch zu modellieren. Einerseits kann ich die Anatomie rüberbringen, also die wirklich wichtigen Inhalte zeigen, andererseits ist auch das Künstlerische und Kreative möglich. So wie ein Fotograf die Möglichkeit hat, Tiefenschärfe zu setzen und mit der Belichtung zu spielen, können wir den Bildinhalt gestalten, und das ist ein sehr kreativer Prozess. Und ähnlich wie bei Robert ist es auch bei mir dieses Umsetzen von Informatik, von Algorithmen in die Programme, mit dem ich meine Kreativität ausdrücken kann.

Prof. Dr. med. Franz A. Fellner

Das, was wir tun, ist in vielerlei Hinsicht kreativ. Dabei stehen wir erst am Anfang, was die unterschiedlichen Anwendungen betrifft. Es gibt medizinische Entwicklungen, vielleicht intraoperative Verwendung im OP-Saal, ein neues Didaktikkonzept, neue Formen der Darstellung der Anatomie in 3-D-Stereoskopie. Es muss ja nicht die16x9-Meter-Darstellung wie im Ars Electronica Center sein, es geht auch kleiner und funktioniert trotzdem hervorragend. Die 3-D-Nachverarbeitung über CT wird auch in ganz anderen Bereichen eingesetzt, zum Beispiel in der Archäologie: Die Archäologen legen alles, was sie finden und was interessant ist, in ein CT-Gerät und nehmen eine 3-D-Nachverarbeitung vor. Für diesen Forschungszweig wird es eine völlig neue Qualität geben. Ein weiteres Beispiel für kreative Anwendungen ist die Materialprüfung. Dafür werden CT-Geräte mit extremer Hochleistung eingesetzt. Für diese Werkstoffprüfungs-CT haben alle Firmen 3-D-Volume-Rendering-Programme, und diese Bilder sind auf einer völlig anderen Qualitätsstufe angesiedelt als bisher. Und nochmals zurück zur Medizin: Eine Leichenanatomie ist für eine Universität natürlich sehr kostenintensiv. In Relation dazu sind die Ausgaben für Beamer-Ausstattung, 3-D-Projektion und den laufenden Betrieb der virtuellen Anatomie relativ gering.

Das Anwendungsspektrum ist für Sie also noch nicht ausgereizt. Das „Handelsblatt“ nennt Ihr Verfahren „eine Innovation, die die Welt von morgen bestimmt“. Welche Wirkung hat Ihre Arbeit allgemein, was bedeutet sie für die Gesellschaft?

Dr.-Ing. Robert Schneider

Langfristig gesehen wird sich unser Rendering-Verfahren überall durchsetzen, und nicht nur wir werden es einsetzen, sondern auch aktuelle und künftige Wettbewerber, das ist nur eine Frage der Zeit. Wir werden die Volumen-Visualisierung revolutionieren. Und wir legen heute das fest, was in ein paar Jahren jeder verwenden wird.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Ich würde zwei Aspekte herausstellen: Einerseits können wir durch die Visualisierung medizinischer Daten das Verständnis der Menschen für den eigenen Körper und das Körpergefühl deutlich steigern. Im Prinzip ist diese Visualisierung des eigenen Körpers das ultimative Selfie, und das wollen wir jedermann zugänglich machen. Das Gesundheitsbewusstsein wird erhöht, wenn man seinen eigenen Körper sieht und auch erkennt, wie fragil manche Teile sind und dass man sich um seinen eigenen Körper kümmern muss. Zudem wollen wir mit Cinematic Rendering die Kliniken effizienter machen. Denken Sie dabei zum Beispiel an die alternde Gesellschaft: Immer mehr Leute mit immer komplexeren Beschwerden kommen ins Krankenhaus, und es treten immer mehr Krankheiten gleichzeitig auf. Nehmen wir ein weiteres Beispiel, einen Unfallpatienten, der in den Trauma-Raum kommt. Sie machen einen Ganzkörper-Scan, um die wesentlichen Verletzungen zu finden und zu priorisieren, wo Sie zuerst eingreifen müssen. Hier können Sie mit Cinematic Rendering die Abläufe effizienter gestalten. Stellen Sie sich nun den Scanner der Zukunft vor. Das Gerät macht automatisch die Aufnahme, analysiert die Informationen, die es gewinnt, erkennt jedes Organ und jeden einzelnen Knochen, identifiziert mögliche Frakturen, präsentiert Ihnen auf dem Bildschirm jeden einzelnen Bestandteil des Körpers realistisch, macht Ihnen vielleicht sogar einen roten Rahmen um Stellen, an denen es Besonderheiten entdeckt hat und auf die Sie genauer draufschauen sollten, und unterstützt Sie, schnell zu einer Entscheidung zu kommen, wie es mit dem Patienten weitergehen soll. Das gesamte Prozedere wird viel effizienter werden.

Prof. Dr. med. Franz A. Fellner

Mit dieser Technik gelingt es, Informationen über Anatomie, pathologische Veränderungen und andere medizinische Aspekte noch viel besser in die Allgemeinheit, vom jungen bis zum älteren Menschen, zu transportieren. Ein weiterer Aspekt: Es handelt sich um eine Bildersprache, die international ist, weil es die einzige Sprache ist, die von jedem auf unserem Planeten verstanden wird. Aber wir sind noch nicht am Ende der Entwicklung angekommen. Es gibt noch viel auf der Welt, was visualisiert werden kann und die Lebensqualität verbessert: Unser Verfahren hat insofern auch einen wichtigen sozialen Aspekt.

Abschließend würden wir gerne von Ihnen wissen, womit Sie sich außerhalb Ihrer Arbeitszeit beschäftigen. Was gibt es denn noch in Ihrem Leben?

Prof. Dr. med. Franz A. Fellner

Das ist eine schwierige Frage für jemanden wie mich, fragen Sie da besser meine Frau Christa. Wir verbringen viel Zeit miteinander. Wir arbeiten im selben Beruf, haben gemeinsame Interessen, zum Beispiel Musik, sowohl passiv als auch aktiv – wenn Sie einen schönen alten Bösendorfer-Flügel finden, wären wir zur Stelle. Wir sehen uns gerne gute Filme an, interessieren uns für Geschichte – auch Kinogeschichte – und sind auch historisch-politisch interessiert.

Dr. rer. nat. Dipl.-Inf. (Univ.) Klaus Dieter Engel

Meine Freizeit wird von unseren Kindern dominiert, die sechs und acht Jahre alt sind und zurzeit im Mittelpunkt stehen. Ansonsten interessiere ich mich für Computergrafik allgemein, für Kunst, insbesondere digitale Kunst. Das Gleiche gilt für Musik, ich bin ein großer Musik- und Hi-Fi-Freund, der immer nach Neuem sucht. Auch mache ich in Maßen Sport, unter anderem wegen der Kinder, schwimme gern und fahre Rad.

Dr.-Ing. Robert Schneider

Ich versuche, so viel Zeit wie möglich mit meiner Frau in der Natur zu verbringen. Wir sind oft in den Bergen, verbringen dort verlängerte Wochenenden oder halten uns bei uns zu Hause in der Natur auf. Wir fühlen uns dort beide wohl, das ist ein sehr guter Ausgleich zur Arbeit. Ansonsten interessiere ich mich für Wissenschaft im Allgemeinen und besonders für die Frage, warum die Naturgesetze so sind, wie sie sind. Wenn man sie ein bisschen abändern würde, könnten wir nicht mehr existieren. Was steckt da mathematisch-physikalisch dahinter? Das ist etwas, was mich sehr bewegt.

Gebärdensprache

Gebärdensprache

Leichte Sprache

Leichte Sprache